Al di là della resa dei conti tra Zuckerberg e il Congresso americano dopo lo scandalo di Cambridge Analytica, e al di là delle risate e dei commenti generati, pare che manchi ancora da parte dei legislatori la capacità di riprendersi la facoltà di legiferare su una realtà, quella di Internet, che ormai somiglia al Far West e in cui i più forti fanno i loro comodi.

A questo proposito si è mossa anche l’Unione Europea, mettendo in campo un proprio “Regolamento per la protezione dei dati”, ma al momento è ancora presto per dire quanto sarà efficace. Per ora, i provvedimenti presi da Zuckerberg sembrano molto superficiali. Uno ad esempio è alzare il tetto d’età per l’utilizzo di WhatsApp, che dal 2014 fa parte di Facebook, dai 13 ai 16 anni. Una misura che, come è ovvio, è destinata a rimanere sulla carta fino a quando non saranno le autorità statali a imporla attraverso una legge e a farla realmente rispettare.

Se oggi la rete è in gran parte terra di nessuno, e quindi dominio di potenti compagnie private, come nella peggiore anarchia del basso medioevo, lo si deve alla convinzione neo-liberista che il miglior modo di far sviluppare una realtà economica sia lasciarla agire senza lacci, affidandola alla forza creatrice e distruttrice dei mercati. Nel caso di Internet questo poteva senz’altro funzionare negli anni Novanta, quando i nodi del network erano ancora pochi, i costi di accesso onerosi e la tecnologia poco abbordabile, ma le speranze di fare soldi investendo in start-up del web altissime. Come andò a finire è noto: tra il 1997 e il 2000, anche a causa del basso costo del denaro, furono investiti enormi capitali che crearono una bolla speculativa, che quando esplose polverizzò miliardi di dollari. Da quel bagno di sangue, però, sopravvissero alcune imprese, come Amazon ed eBay, che avrebbero in futuro giocato il ruolo di egemonie.

Da quel momento le cose non sono cambiate più di tanto. Il web, concepito e implementato grazie a fondi pubblici americani, pur essendo utilizzato in ogni angolo del pianeta, è tuttora gestito da agenzie che fanno riferimento agli Stati Uniti. A deciderne il destino, e a farvi enormi profitti mai tassati in modo adeguato, sono una manciata di imprese private – spesso a proprietà individuale – come Facebook o Google. Nel corso della storia, la circolazione di merci e informazioni è sempre stata considerata strategica, dato che poteva, e può tuttora, fare la differenza per la sicurezza e la prosperità di uno Stato, eppure oggi troviamo accettabile che questi colossi disegnino da sé le loro regole, perché forse sono molto abili nel farci credere che siano al nostro servizio. Il confronto tra interesse privato e interesse pubblico è un’altra questione cardine della storia della civiltà. Lo stato moderno è nato proprio cancellando, faticosamente, gli ingiusti privilegi della nobiltà, nuclei di potere a base locale che si erano garantiti con la forza e il sopruso terre e risorse. Oggi, però, la situazione sembra ribaltarsi. Gli Stati nazionali arretrano, e ristrette oligarchie, questa volta a livello planetario, avanzano, accrescendo le loro pretese.

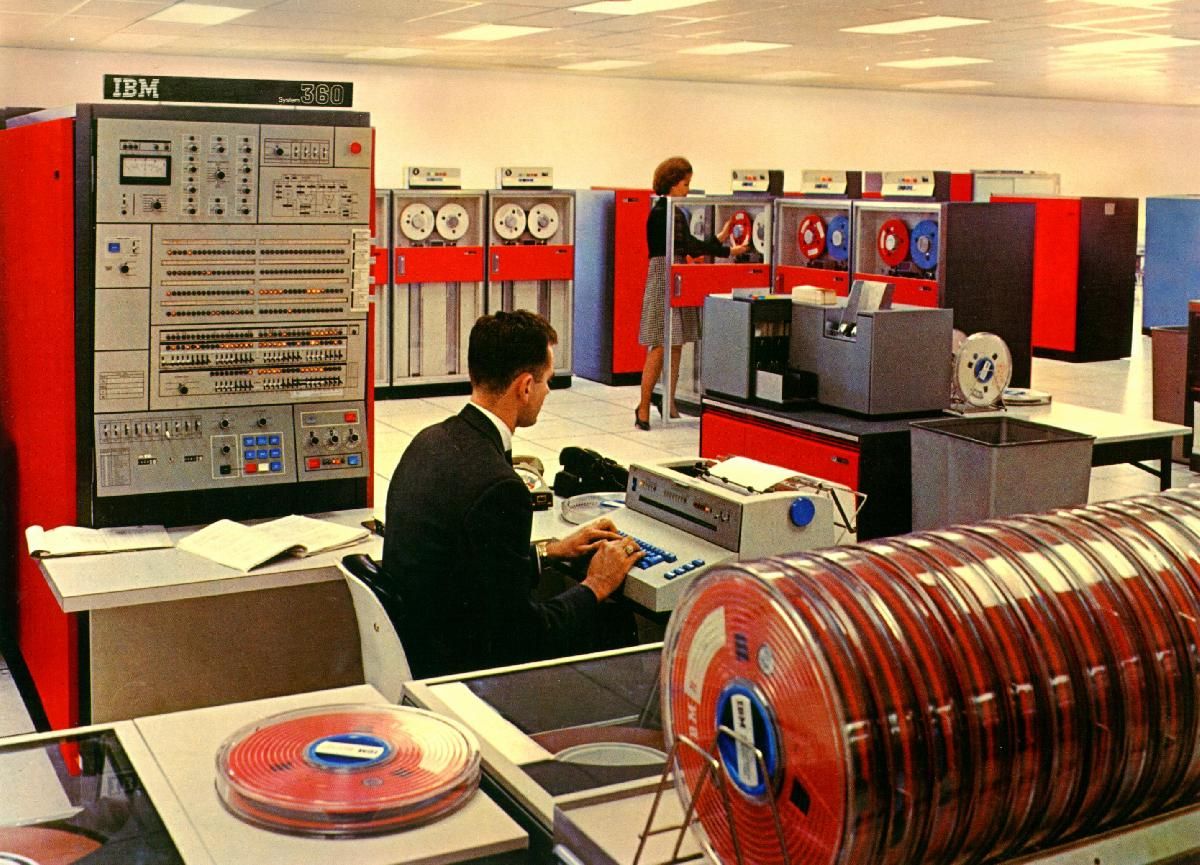

Se torniamo indietro nel tempo, però, scopriamo che la vicenda della rete ha preso il suo avvio grazie alle risorse investite dallo Stato in un contesto pubblico. Negli anni Cinquanta, i cittadini del Paese più tecnologicamente avanzato del mondo, gli Stati Uniti, non avevano mai toccato un computer. Anzi, si può dire che fossero praticamente ignari dell’esistenza di queste macchine appena inventate. Non solo non esisteva il concetto di user-friendly, ma non esistevano neanche i generici users. In quell’epoca, che oggi sembra lontanissima, solo alcune grandi istituzioni di ricerca disponevano dei computer e una di queste era il prestigioso Massachusetts Institute of Technology (MIT). I calcolatori, prodotti in via quasi esclusiva dall’IBM, una ditta che prosperava sulle pubbliche commesse, erano molto diversi da quelli che conosciamo oggi, erano enormi e incredibilmente costosi. Per interagire con loro, attraverso schede di cartone traforato, occorreva personale altamente qualificato, una cerchia ristretta di impettiti operatori informatici, più simili a bramini che a tecnici.

Le macchine venivano impiegate esclusivamente per fare analisi statistiche, progetti di sistemi missilistici e altre simulazioni che avevano a che fare per lo più con la difesa dello Stato. Non c’era spazio per la ricerca fine a se stessa, c’era la guerra fredda. Il mondo era diviso in blocchi e anche i computer facevano la loro parte. Di lì a poco, con la loro capacità di calcolo, sarebbero diventati i protagonisti della corsa allo spazio. Per questo motivo il governo degli Stati Uniti investì in quel settore una quantità vertiginosa di denaro.

In seguito, come succede spesso nelle forme di pensiero matematico, alcuni studenti particolarmente promettenti del MIT iniziarono a trattare la scrittura di programmi come una vera e propria forma d’arte. Una gara che somigliava a quella che i giovani poeti europei erano soliti indire molti secoli prima, misurando i propri componimenti sul confine della metrica classica. Scrivere un programma formalmente bello – anche se di una bellezza algida e inaccessibile ai più – era una soddisfazione a sé, le applicazioni pratiche a quel punto potevano quasi considerarsi come un volgare derivato. Peter Samson, ad esempio, era riuscito a trasformare il computer in un sintetizzatore: collegando un altoparlante, venivano generati dei suoni che sembravano note. I primi risultati erano stati molto scadenti, d’accordo ma, per la prima volta nella storia, la musica non era stata prodotta per vibrazione, ma scritta in un codice, incorporata nella macchina e sintetizzata. Grazie a queste pratiche si era intuito che i computer, lungi dal limitarsi a soddisfare le esigenze militari, riservavano altre possibilità, potenzialmente infinite e ancora tutte da esplorare.

Grazie a questi “irregolari”, al MIT stava nascendo una nuova filosofia, che avrebbe rivoluzionato il rapporto uomo-macchina. Come racconta bene il giornalista americano Steven Levy, uno dei primi ad aver analizzato il fenomeno, questi risultati erano stati ottenuti in modo furtivo, rubando di nascosto prezioso tempo-macchina ai calcolatori dal loro impiego istituzionale. I ricercatori capirono in fretta che le autorità avevano tentato di tenerli all’oscuro di queste potenzialità e che con i calcolatori si potevano fare cose estremamente creative. In definitiva, una volta liberati da un impiego eccessivamente ottuso, i computer avrebbero potuto trasformare in meglio la vita di tutti noi, ma perché questo avvenisse occorreva che chiunque – o, almeno, chiunque ne fosse in grado – potesse averne libero accesso e che ogni informazione riguardo al loro utilizzo fosse a disposizione di tutti. Non erano stati forse i finanziamenti pubblici a consentire lo sviluppo di queste tecnologie? Per quale ragione avrebbero dovuto rimanere appannaggio esclusivo di una casta ristretta anziché giovare alla società nel suo insieme? Eppure, questa generazione di sognatori – che, tra l’altro, nei momenti di svago, aveva inventato anche il primo videogioco della storia, Spacewar! – non era riuscita a valicare le ristrette frontiere della tecnologia di alto livello, né ad avvicinare l’informatica alla gente comune. Non per mancanza di visione e di entusiasmo, ma per il semplice motivo che in quel periodo i computer erano realmente inaccessibili.

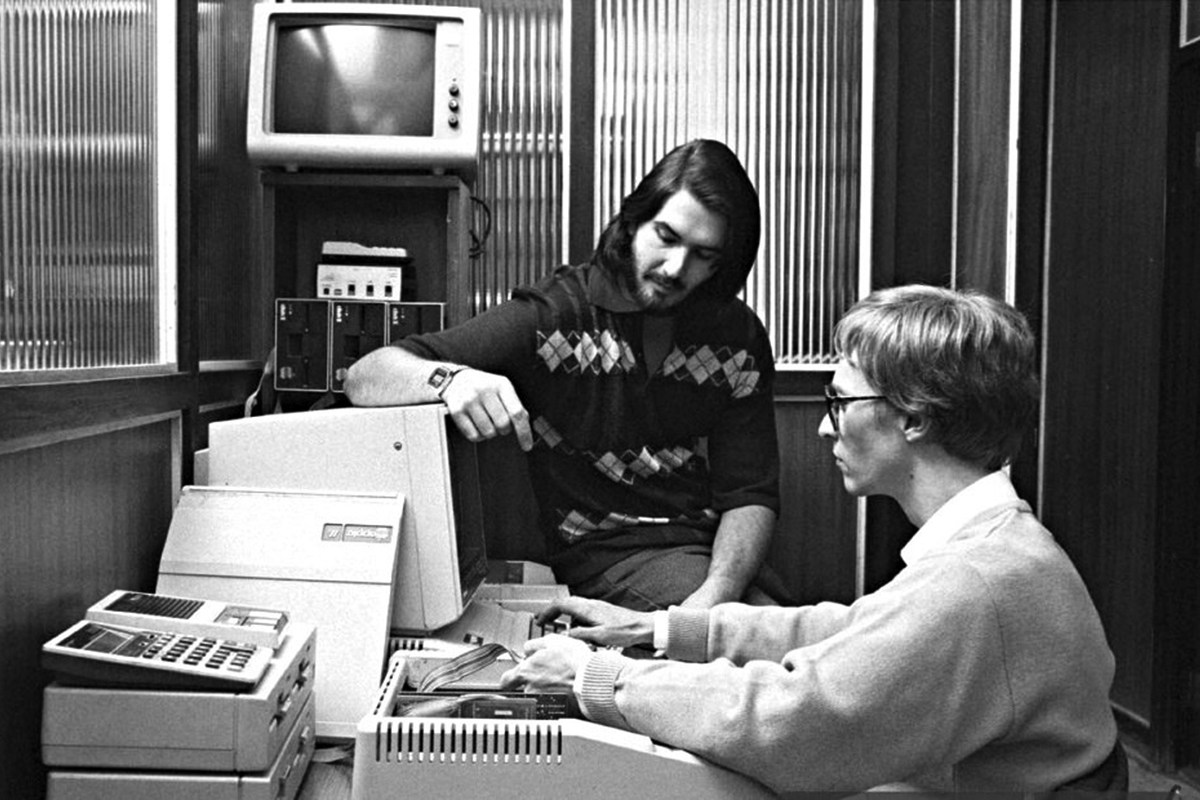

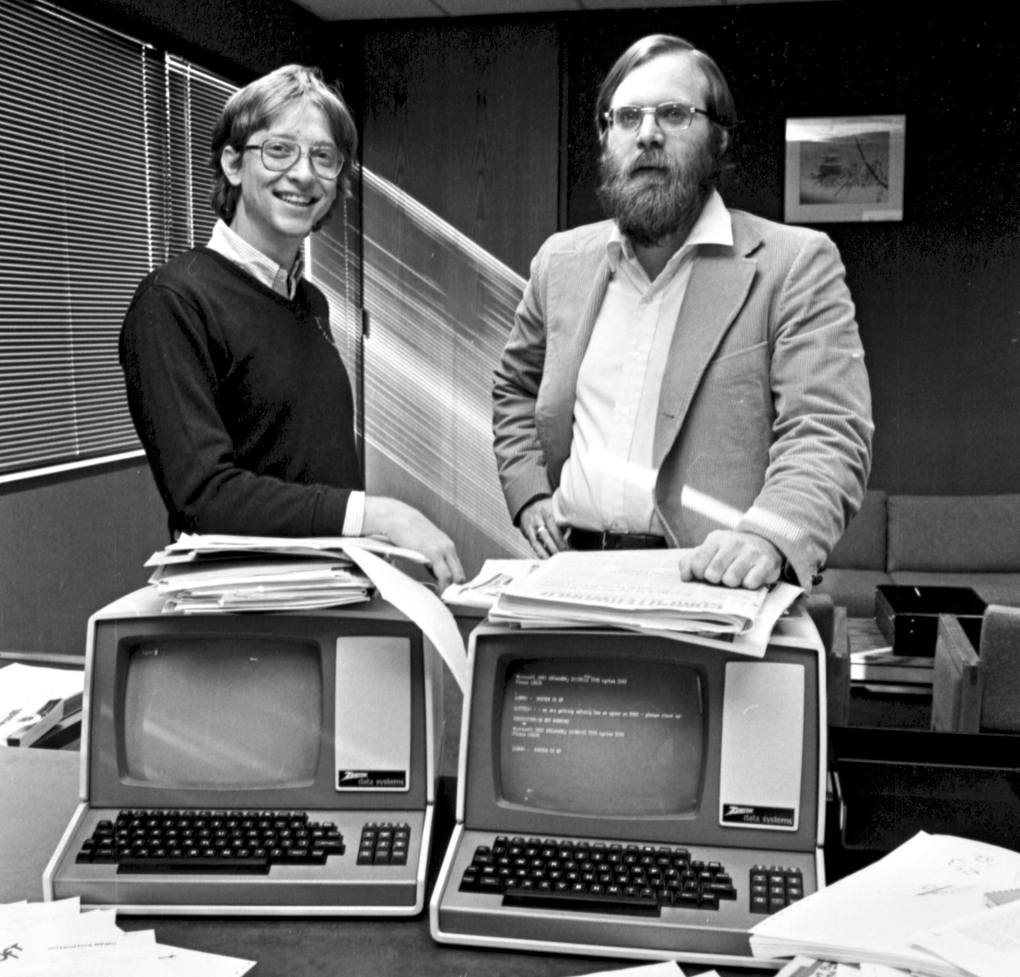

Intanto, verso la fine degli anni Sessanta, ancora una volta a causa della guerra fredda e tramite finanziamenti pubblici, era stata messa in campo una nuova idea di telecomunicazione destinata a cambiare il mondo. In caso di guerra, infatti, bombardamenti e sabotaggi avrebbero potuto facilmente mettere fuori uso le linee telefoniche e le stazioni radio; se però si fossero collegati, fisicamente o attraverso onde radio, dei computer, come tanti nodi di una rete, probabilmente sarebbe stato possibile continuare a comunicare anche in seguito a un attacco nucleare. Almeno in linea teorica. Per fortuna il progetto, che si chiamava Arpanet (Advanced Research Projects Agency NETwork), e che oggi tutti conosciamo come “Internet”, non è mai stato messo empiricamente alla prova. Ancora una volta, a produrre questo straordinario progresso tecnologico erano stati cospicui fondi pubblici, che venivano in questo caso da un’agenzia del ministero della Difesa degli Stati Uniti. Appena nato, però, Internet non era meno elitario dei grossi calcolatori dell’IBM dislocati nelle grandi università. Perché l’informatica raggiungesse le persone comuni, e cominciasse a cambiare davvero la loro vita, fu necessario attendere la seconda metà degli anni Settanta, quando entrarono in scena due grandi visionari: Bill Gates e Steve Jobs.

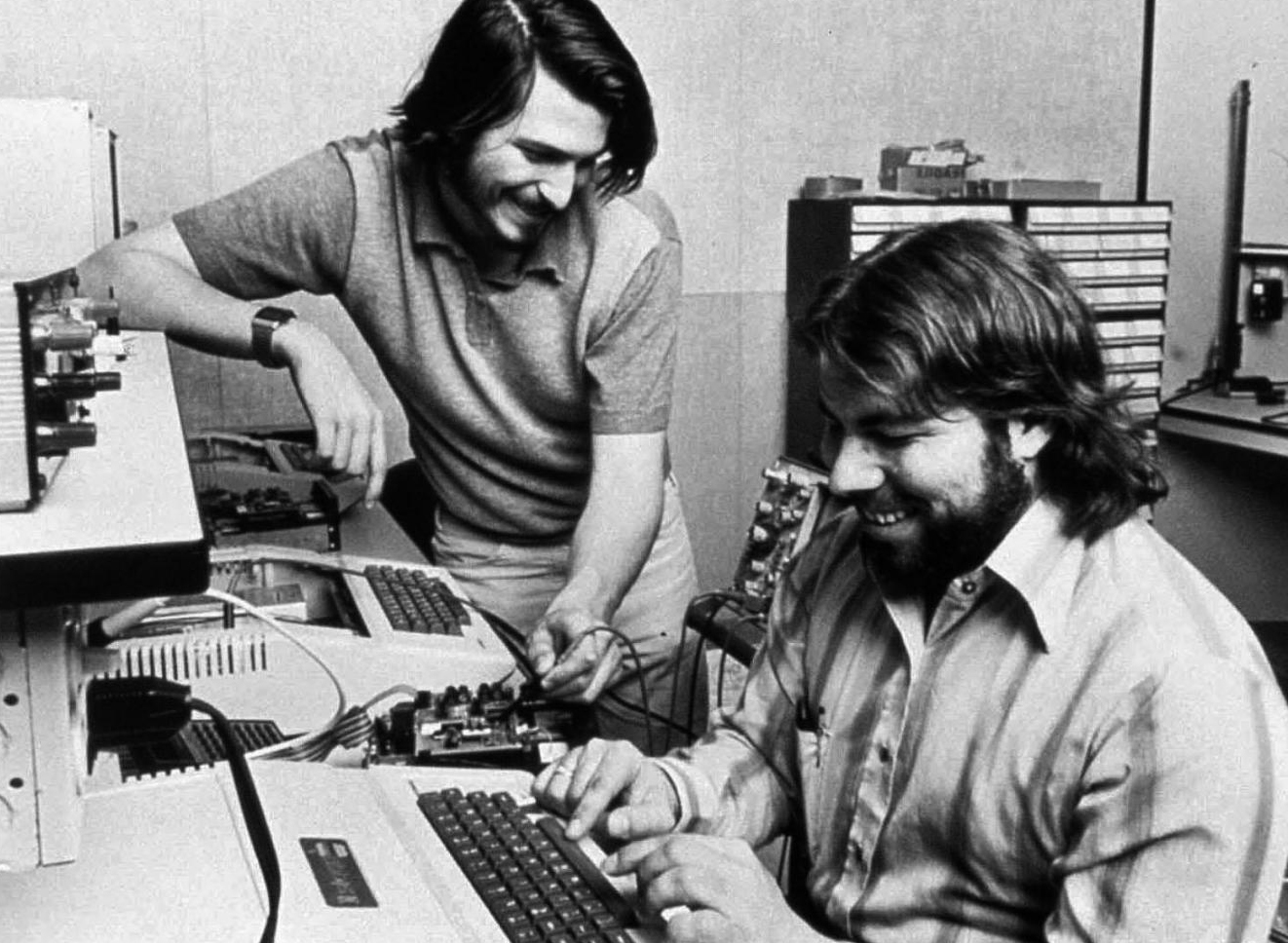

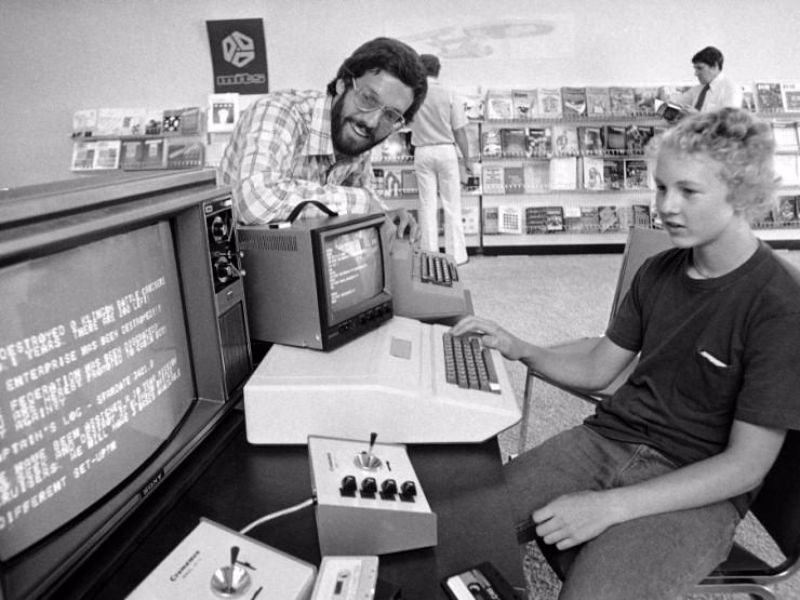

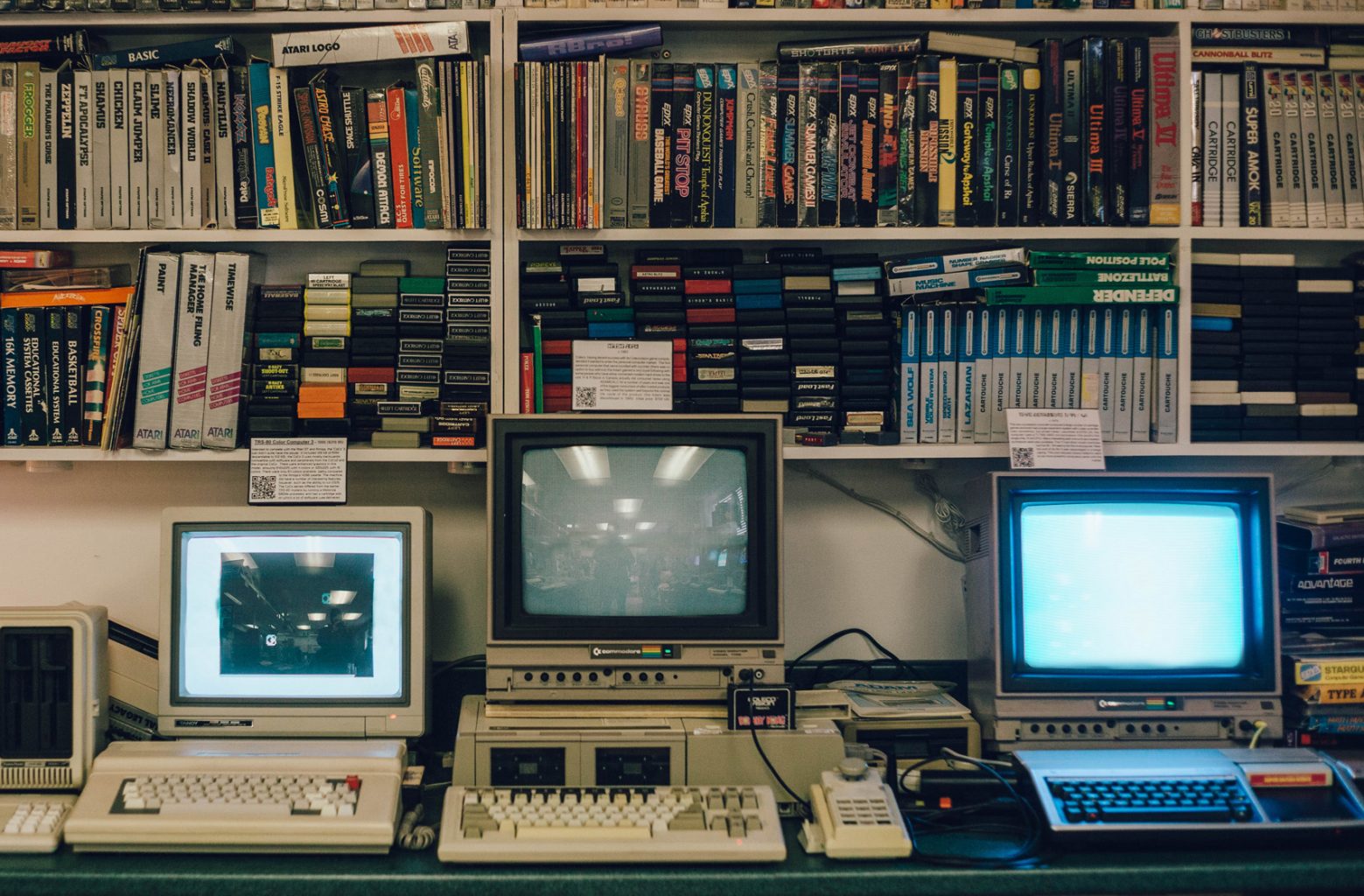

Gates ha creato il proprio impero scrivendo i primi linguaggi operativi che consentivano anche a utenti non professionisti di comunicare con i neonati micro-computer – abbastanza economici da essere acquistati da utenti privati, ma ancora molto complessi da usare. Uno di questi primi modelli, l’Altair 8800, per noi sarebbe un vero e proprio enigma: privo di monitor, tastiera e mouse, era programmabile attraverso una serie di leve e di led e la sua versione più economica veniva consegnata ancora da assemblare. L’idea geniale di Gates non era stata di inventare ex novo un software per rendere più facile l’interazione con l’Altair, ma prendere il Basic, un linguaggio già esistente sviluppato ad Harvard negli anni Sessanta, e adattarlo alle esigenze dell’Altair: aveva così più probabilità di diffondersi nelle case degli americani. Il fondatore di Apple, Steve Jobs, però, avrebbe fatto anche meglio: progettato nel 1976 uno dei primi micro-computer, l’Apple I, nel 1977 lo perfezionò con successo trasformandolo nell’Apple II e, in seguito, nel 1984, mise in commercio macchine compatte dotate di avveniristici sistemi operativi incapsulati, i MacIntosh.

Oltre a essere imprenditori privati, che avevano creato società capaci di generare enormi profitti e raggiungere una platea mondiale, Gates e Jobs avevano qualcos’altro in comune: entrambi vendevano a caro prezzo i loro prodotti e non volevano che nessun altro ci mettesse mano, neanche dopo averli acquistati. Il sistema operativo di Gates era un sistema chiuso, già caricato sulla maggior parte dei personal computer in commercio. Almeno in teoria, l’acquirente non aveva alcun diritto di modificarlo, neanche per migliorarlo. Lo stesso per i computer di Jobs, noto per l’aforisma “La gente non sa ciò che vuole, finché non glielo fai capire tu”, destinati a una fascia più alta di consumatori. Questi prodotti erano concepiti in modo che loro fossero i soli a trarne vantaggio, anche se questa logica poteva andare a discapito della collettività.

Mentre questi colossi si spartivano il mondo dell’home computing, che di anno in anno si allargava, sotterraneamente si diffondeva quel tipo di cultura contestataria che aveva animato il MIT. Le domande erano sempre le stesse, ma adesso riguardavano molte più persone. Per quale ragione bisognava rispettare il copyright che Bill Gates aveva messo sul suo sistema operativo? E perché non si poteva collegare un Apple a un’interfaccia di propria produzione? Questi divieti erano veramente il modo migliore di far funzionare le cose? Sul finire degli anni Settanta queste domande viaggiavano da un capo all’altro del mondo, sempre entro una ristretta cerchia di persone, anche grazie a un’altra invenzione, il Bulletin Board System, o BBS. Un BBS era un comune computer domestico su cui girava un software che consentiva ad altri computer di collegarsi attraverso la rete telefonica. In pratica, i BBS anticipavano alcune funzioni che in seguito Internet avrebbe messo alla portata di tutti: un servizio primitivo ma efficace di messaggeria e scambio di file. Tra mille limiti tecnici, si erano create comunità di persone con interessi comuni, che potevano comunicare e scambiarsi informazioni.

La maggior parte dei BBS aveva l’obiettivo di scambiare fotografie pornografiche o interi programmi copiati, applicazioni, codici per craccare i videogiochi, istruzioni per rompere le barriere imposte dai produttori di sistemi operativi e, in alcuni casi, anche suggerimenti per sfruttare le falle delle grandi compagnie informatiche e telefoniche. Il pioniere in questo campo era stato John Thomas Draper, considerato uno dei primi hacker della storia. Già all’inizio degli anni Settanta, Draper aveva scoperto che il fischietto in regalo con i cornflakes Captain Crunch emetteva la stessa frequenza usata dalla compagnia telefonica AT&T per connettere le telefonate interurbane; chiunque, grazie a pochi accorgimenti, poteva dunque fare telefonate interurbane gratuite ed erano proprio i BBS a divulgare informazioni come queste.

Via via che cresceva lo strapotere di Gates e Jobs, una vena sotterranea di seguaci di Draper tentava di riprendersi il possesso di tecnologie sempre più privatizzate attraverso intrusioni nelle reti informatiche. Il 15 gennaio del 1990, gli hacker americani riuscirono a mandare per alcune ore in collasso l’intero sistema telefonico statunitense. Questo era veramente troppo: le autorità risposero con l’operazione “Sundevil”, ricostruita al dettaglio dallo scrittore americano Bruce Sterling in Giro di vite contro gli hacker, nel corso della quale furono impegnati 150 agenti, che eseguirono 3 arresti e 27 perquisizioni. Molti BBS furono chiusi, qualcuno degli arrestati patteggiò, altri finirono in galera con l’accusa, infondata, di aver procurato danni per milioni di dollari alle compagnie telefoniche. Il protagonista di questa vasta operazione di polizia, che per la prima volta nella storia non veniva compiuta nel mondo reale ma in quello che all’epoca veniva chiamato il cyber-spazio, era lo Stato, lo Stato che riprendeva il controllo, mettendo un freno alle scorribande di pirati e delinquenti che anziché usare passamontagna e pistole usavano computer e reti. Ma come ha ben spiegato Sterling: “Fu il più esteso, meglio organizzato, più deliberato e risoluto di ogni altro precedente sforzo compiuto nel nuovo mondo del crimine elettronico. Il Servizio Segreto degli Stati Uniti, le organizzazioni private di sicurezza delle compagnie telefoniche, le polizie locali e nazionali di tutto il paese misero insieme le forze in un deciso tentativo di spezzare la schiena all’underground elettronico americano.”

A distanza di molti anni, possiamo dire che quello non fu soltanto un tentativo. La controcultura hacker ne uscì a pazzi. Gli strumenti dello Stato erano stati usati in difesa dei grandi gruppi privati che si erano spartiti, privatizzandole, le tecnologie nate grazie agli investimenti pubblici. Da quel momento, Internet, l’ex progetto Arpanet, iniziò a diffondersi nel mondo occidentale, prima ampliando la rete iniziale di università, e poi continuando ad accrescersi via via di nuovi nodi e collegamenti. Ci erano voluti circa vent’anni perché questa invenzione raggiungesse il pubblico di massa con un canone non basso ma pur sempre accessibile alle famiglie benestanti. Usando la rete telefonica e un modem, le persone comuni, dotate di una minima capacità tecnologica, cominciavano ad affacciarsi alla rete grazie all’invenzione del web e di interfacce di navigazione più facili da utilizzare. Tutto questo, però, avveniva in un mondo dominato da un ordine liberista, dove nulla frenava l’iniziativa privata.

Nel frattempo, nel 1995, Amazon muoveva i suoi primi passi, seguito da Facebook, nel 2004, e da tutti gli altri principali player della rete. Se negli anni Novanta restava ancora qualcosa dello spirito libertario degli hacker, era la possibilità di muoversi all’interno della rete in un anonimato più o meno totale. Una cosa che, nel mondo reale, era ormai impossibile. L’ultimo Paese del mondo a permettersi il lusso di non rilasciare ai suoi cittadini la carta d’identità era stata la Gran Bretagna, ma aveva smesso di farlo all’inizio della prima guerra mondiale. Per questa ragione, si poteva considerare il web come l’unico luogo rimasto, in cui gli individui potevano ancora manifestarsi in assoluta libertà, senza doversi assoggettare a leggi, usi e costumi a cui, in un modo o nell’altro, dovevano sottostare già nella vita di tutti i giorni.

Negli anni Novanta, il controverso teorico americano dell’anarchismo Peter Lamborn Wilson, o Hakim Bey, aveva sostenuto l’idea che, per salvarsi dall’omologazione forzosa, bisognasse lasciare libera almeno un’area del proprio cervello, in modo da poter continuare a pensare in modo autonomo, senza essere sopraffatti dal modo di pensare e di vivere comune. Wilson aveva chiamato questi spazi mentali liberi “zone temporaneamente autonome”, un concetto che fa da eco alle effimere società formate dai pirati, fuori dalla giurisdizione degli Stati e dai dettami della morale tradizionale. Per formare queste “zone mentali”, con la speranza di poterle ampliare e farle diventare reali, era fondamentale che le informazioni viaggiassero liberamente tra le crepe di un sistema sempre più rigido e pervasivo. Un uso accorto di Internet, che consentiva il diffondersi di ogni genere di pensiero, oltre le maglie della censura, sembrava la strada giusta.

Almeno fino a oggi, però, Internet non ha aumentato la democrazia nel mondo. E questo anche perché i grandi player privati che lo governano come cosa propria, vedi Google o Facebook, sono sempre pronti ad autocensurarsi quando a richiederlo sono governi autoritari e dittatoriali, in cambio della libertà di operare nei loro confini. L’individuo libero, il “pirata virtuale” teorizzato da Hakim Bey che, sfrattato dai mari caldi del Sud, cercava ospitalità virtuale nella rete, oggi non esiste più, può conservare al massimo un anonimato apparente, quello del singolo che si muove in una massa immensa, convinto per questo di passare inosservato. Un’illusione che in Paesi come la Cina sta diventando sempre più difficile anche nella realtà fisica, dato che lo Stato è in grado di individuare un ricercato all’interno di uno stadio solo grazie a telecamere e sofisticati software di riconoscimento facciale.

Quello che è certo è che i dati di oltre due miliardi di utenti sono vulnerabili e che verranno impiegati in misura sempre più massiccia per influenzare le nostre scelte come consumatori ed elettori. L’invadenza delle società che sfruttano i big data dovrà essere prima o poi regolata, pena la diminuzione della nostra libertà. Dovremo accettare l’idea che il Far West della rete e delle nuove tecnologie trovi le sue leggi, e quindi i suoi sceriffi: la temuta censura contro la quale la rete, alla sua nascita, sembrava proprio il libertario antidoto. Ma quello valeva quando le tecnologie non condizionavano ancora la vita di tutti. Per questa ragione, una qualche forma di controllo esercitata dallo Stato non è necessariamente liberticida, soprattutto in un’epoca come la nostra, in cui gli spazi comuni si sono ristretti e tutto sembra appiattito in difesa degli interessi privati, e quindi dei pochi, a discapito dei molti, della comunità.